I februari 2026 sjönk mjukvarubolag som Salesforce, Intuit på Nasdaq med upp till 30 procent. 1 Wall Street döpte det till “SaaSpocalypsen”. Bolag som Salesforce, Adobe, Intuit och ServiceNow tappade 25–30 procent på några veckor.2 Marknaden bestämde sig för att AI-agenter snart gör jobbet som idag kräver mänskliga användare, och då behövs färre licenser.

Kanske stämmer det. Men vi är ännu inte helt övertygade. Exempelvis Yales forskning om AI och arbetsmarknaden visar att efter tre år av intensiv AI-hype har de inte kunnat mäta någon betydande påverkan på sysselsättningen.3 Yrken med hög AI-exponering har ännu inte högre arbetslöshet.

Samtidigt hör vi IT-chefer som berättar att de byggt agenter i Microsoft Copilot för att sammanställa underlag inför revisioner m.m.4 Och i kodarvärlden har som

Så vad är det egentligen? Hype eller verklighet? Troligen båda.

Vart är vi idag?

Vi gick igenom 14 leverantörer6 av ledningssystem och

Aktiviteten finns. Men att en agent kan generera ett utkast är en sak. Att den kan ta ansvar för en hel process (registrera en avvikelse, bedöma konsekvenserna, koppla till rätt process, initiera en åtgärd och följa upp) är något helt annat.

Och det är inte bara en teknisk utmaning. Det finns goda skäl att vara försiktig.

Säkerhetsrisker. Agenter som har åtkomst till system kan enkelt exfiltrera (dvs låta någon stjäla) data, följa injicerade instruktioner i dokument de läser (prompt injection) för att göra vad som helst på din dator.

Rapporterna om agenter som läcker information eller manipuleras av illvillig input växer vecka för vecka. I ett ledningssystem där poster styr hur organisationen arbetar och data som lagras ofta är väldigt känslig är konsekvenserna höga.

Produktivitetsvinsten kanske inte är vad den ser ut att vara. Agenten gör jobbet på 42 sekunder istället för en hel dag. Men var resultatet korrekt? Tar granskningen lika lång tid som att göra det manuellt? Vi har skrivit om den frågan tidigare baserat på Yale-forskning: efter tre år av AI-hype har forskarna inte sett mätbar påverkan på arbetsmarknaden. Det borde ge oss alla en paus.

Vad vi byggt

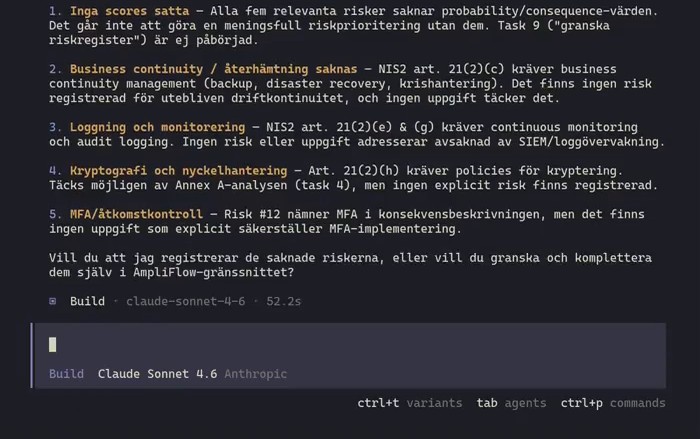

Det är svårt att prata om agenter. Så här är 42 sekunders video som visar en agent läser 9 uppgifter och 5 befintliga risker, jämför mot NIS2-kraven, hittar 5 luckor, och registrerar dem direkt i AmpliFlow:

Det är af-cli

af-cli

Det är en fungerande Labs-produkt. Binären finns på GitHub och du kan ladda ner och köra den. Men vi rekommenderar den inte som annat än research. Den finns för att vi vill förstå vad som är möjligt, inte för att vi tror att alla ska ersätta sina arbetsflöden imorgon.

Och den som fortfarande vill registrera avvikelser genom att klicka i AmpliFlow gör det. Samma data, samma system.

Vad vi inte vet

Det kan visa sig att agenter i ledningssystem blir lika omvälvande som internet var för kontorsarbete. Det kan visa sig att det är kejsarens nya kläder.

Vi har en fungerande produkt och en demo som visar vad som är tekniskt möjligt. Vi har också Yale-forskning som visar att tre år av hype inte gett mätbar effekt, och en växande lista av säkerhetsincidenter där agenter som fått löpa amok är boven i dramat.

Om ni redan låter medarbetare använda AI-verktyg (ChatGPT, Copilot, Claude), har ni ett styrningsbehov som växer.

Vi testar, försiktigt, och vi delar vad vi hittar. Så här ser det ut just nu.

Footnotes

-

a16z, “Good news: AI Will Eat Application Software”, mars 2026: “Since the start of 2026, ETFs for public software companies have fallen by 30 percent, erasing all the gains since the launch of ChatGPT.” https://a16z.com/good-news-ai-will-eat-application-software/ ↩

-

a16z, samma källa: “Companies like Salesforce, Adobe, Intuit, ServiceNow, and Veeva…are down 25 to 30 percent in a matter of weeks.” ↩

-

Yale Budget Lab, “Evaluating the Impact of AI on the Labor Market”, 2025: “Den bredare arbetsmarknaden har inte upplevt en märkbar störning sedan ChatGPT:s lansering.” Goldman Sachs-referensen om AI-investeringar från samma rapport. https://budgetlab.yale.edu/research/evaluating-impact-ai-labor-market-current-state-affairs ↩

-

Microsoft, Ignite 2024, november 2024: “Nearly 70% of the Fortune 500 now use Microsoft 365 Copilot”. https://blogs.microsoft.com/blog/2024/11/19/ignite-2024-why-nearly-70-of-the-fortune-500-now-use-microsoft-365-copilot/ ↩

-

a16z, “The Top 100 Gen AI Consumer Apps, 6th Edition”, mars 2026. https://a16z.com/100-gen-ai-apps-6/ ↩

-

Egna undersökningar, mars 2026. Leverantörer granskade: ServiceNow, SAP, MasterControl, Stratsys, Onspring, LogicGate, ETQ/Hexagon, Qualio, Greenlight Guru, Diligent, Archer, MetricStream, Clarendo och Centuri. ↩

-

ServiceNow, “AI Agents”. Erbjuder “AI Agent Orchestrator”, “Agent Studio”, och “Autonomous Workforce” för IT- och säkerhetsprocesser. https://www.servicenow.com/products/ai-agents.html ↩

-

SAP, “AI Agents”. “Joule Agents” för ekonomi, inköp, supply chain, HR. https://www.sap.com/products/artificial-intelligence/ai-agents.html ↩

-

MasterControl, “AI for Life Sciences, Quality & Manufacturing”. Beskriver “Secure agentic AI platform” men varje verktyg kräver mänsklig initiering och godkännande. https://www.mastercontrol.com/ai-for-life-sciences-quality-manufacturing/ ↩

-

Stratsys, “Stratsys AI”. Nämner “AI-agenter” men funktionerna är sammanfattning, förslag och analys. https://www.stratsys.com/sv/stratsys-ai ↩

-

Europaparlamentets och rådets förordning (EU) 2024/1689 (AI-förordningen). Artikel 50 ställer krav på transparens för AI-genererat innehåll. ↩

-

a16z, samma källa: “In January 2026, an open-source project called OpenClaw went from a solo developer’s side project to 68,000 GitHub stars…became the most-starred project on Github…acquired by OpenAI in February 2026.” ↩