Era medarbetare använder redan AI Har ni kontroll på verktyg, data och ansvar?

ChatGPT, Copilot och AI-funktioner dyker redan upp i vardagen hos små och medelstora bolag. Frågorna kommer direkt: vilka verktyg får användas, vilken data får matas in, vem äger riskerna och vad gör ni när något går fel? ISO 42001 ger strukturen. AmpliFlow gör det till ett digitalt AI-ledningssystem som blir en del av det dagliga arbetet.

AmpliFlow deltog i ISO:s arbetsgrupp för ISO/IEC 42001.

Så ser AI-styrning ut i praktiken för ett SMB-bolag

Poängen är inte att skriva en AI-policy och hoppas på det bästa. Poängen är att få ett arbetssätt som gör AI-användningen trygg, spårbar och enkel att följa upp i vardagen.

Godkända verktyg och tydliga spelregler

Samla vilka AI-verktyg som får användas, för vilka ändamål och med vilken data. Medarbetare slipper gissa, chefer slipper jaga svar i efterhand.

Ägarskap, risker och incidenter i samma flöde

Koppla varje AI-system till ansvariga, risker, konsekvensbedömningar och åtgärder. När något går fel finns redan ett spårbart sätt att rapportera, utreda och följa upp.

Klara svar till kunder, revisorer och ledning

När någon frågar hur ni styr AI kan ni visa mer än fina ord. Ni kan visa policy, utbildning, riskarbete, beslut och uppföljning i ett sammanhang.

Starta med plattformen, utan att bygga allt själva

Mini passar er som vill driva mer av AI-ledningssystemet själva, men inte börja i ett tomt system. Vi sätter upp miljö, grundmallar, kontrollstruktur och AI-stöd så att ni snabbt kan gå från osäker AI-användning till ett arbetssätt som faktiskt används.

Var står ni mot ISO 42001 idag?

Få en tydlig bild av ert AI-styrningsläge – kostnadsfritt och utan bindning. Svara på 12 frågor baserade på ISO 42001:s klausuler och få konkreta rekommendationer på vad som behöver stärkas.

Gap-analys: Var står ni mot ISO 42001?

Svara på 12 frågor baserade på ISO 42001:s klausuler (kontext, ledarskap, planering, stöd, drift, utvärdering, förbättring) och få en bedömning av ert AI-styrningsläge – plus konkreta tips på nästa steg.

AI blir ett ledningsproblem långt innan det blir ett certifieringsprojekt

För SMB-bolag handlar ISO 42001 först om att få ordning på vardagen, inte om att samla fler policydokument.

Ingen vet vilka verktyg som faktiskt används

AI-användningen börjar ofta i små steg. Någon summerar möten, någon skriver kundmail, någon testar kod eller offertutkast. Utan en gemensam struktur blir det oklart vilka verktyg som är godkända, vilken data som får användas och vem som ansvarar för besluten.

Kundfrågor och upphandlingar blir svåra att svara på

När kunder, moderbolag eller större upphandlare frågar hur ni styr AI räcker det inte att säga att ni 'är försiktiga'. De vill se policy, ägarskap, riskbedömning, utbildning och uppföljning som hänger ihop.

Små misstag blir riktiga verksamhetsproblem

Felaktiga AI-svar, kunddata i fel verktyg eller oklara ansvarslinjer är inte teknikdetaljer. De blir supportärenden, avtalsrisker, GDPR-frågor och förlorat förtroende. ISO 42001 hjälper er bygga ett arbetssätt innan problemen blir dyra.

Vad ni säger vs vad revisorn letar efter

Det finns en skillnad mellan att ha ett AI-ledningssystem och att leva det. Här är vad revisorn faktiskt kollar:

Från ordningsfråga till fungerande AI-styrning

AmpliFlow samlar AI-policy, godkända verktyg, riskbedömningar, konsekvensbedömningar, åtgärder och uppföljning i samma system. När ni sedan vill jobba mot ISO 42001 finns Annex-kontrollerna, SoA-stödet och uppgiftshanteringen redan på plats.

AI-driven riskanalys

AmpliFlows AI genererar riskscenarier och konsekvensanalyser automatiskt. Kombinera det med ORA för att bedöma AI-risker enligt ISO 42001 (6.1.2).

Konsekvensbedömning för AI-system

Dokumentera hur era AI-system påverkar individer och samhället. Ett unikt krav i ISO 42001 (6.1.4, A.5).

Statement of Applicability (SoA)

SoA genereras automatiskt baserat på era ställningstaganden per kontroll. Motivera inkluderade och exkluderade kontroller direkt i kontrollregistret (6.1.3e).

Lagbevakning för EU AI Act

Lägg till EU AI Act i lagregistret. Sätt måldatum för när ni ska vara klara med anpassningar.

Processkartor för AI-påverkade processer

Dokumentera vilka processer som använder AI och hur. Koppla AI-verktyg till processteg.

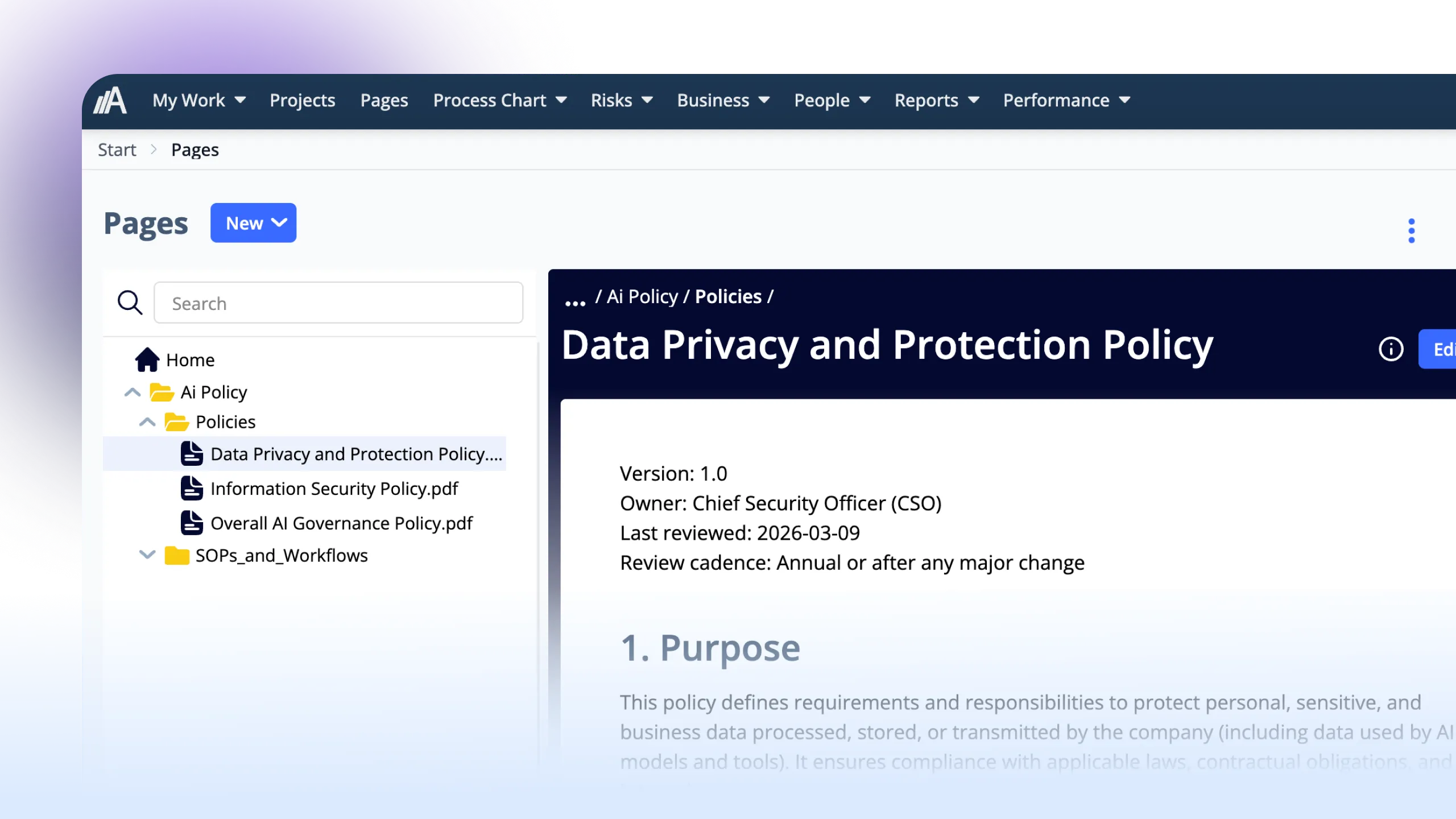

AI-policyer via Pages

Skapa AI-policyer i den inbyggda textredigeraren (wiki). Organisera i mappar och dela med medarbetare.

Intressentanalys med ISO 42001-koppling

Kartlägg intressenter som påverkas av er AI-användning och deras krav.

Åtgärdshantering för AI-initiativ

AmpliFlows AI föreslår åtgärder och förbättringar. Följ upp med ansvariga och deadlines.

Ansvarsfull AI i praktiken

ISO 42001 bygger på principer för ansvarsfull AI. AmpliFlow hjälper er omsätta principer till konkreta åtgärder.

Transparens

Förklara hur AI-system fungerar och fattar beslut

Rättvist

Undvik bias och säkerställ likabehandling

Ansvarsskyldighet

Tydligt ägande och ansvar för AI-beslut

Säkerhet

Skydda mot missbruk och oavsiktlig skada

Förbered er för EU:s AI-förordning

EU AI Act är världens första omfattande AI-lagstiftning. ISO 42001 underlättar arbetet med att möta kraven.

Risklassificering

Klassificera era AI-system enligt EU:s risknivåer: oacceptabel, hög, begränsad eller minimal risk.

Dokumentationskrav

Uppfyll kraven på teknisk dokumentation, användarinstruktioner och kvalitetsledning.

Efterlevnadsbevis

Visa tillsynsmyndigheter att ni har kontroll. ISO 42001-certifiering ger trovärdig bevisning.

Tidslinje

EU AI Act träder i kraft stegvis: förbjudna AI-system sedan februari 2025, krav på GPAI-modeller sedan augusti 2025, högrisk-system från augusti 2026. Böter upp till 35 miljoner euro eller 7 procent av global omsättning. Observera: ISO 42001 är inte en harmoniserad standard under AI Act och ger ingen presumtion om överensstämmelse, men den ger en beprövad struktur som stödjer efterlevnad.

Klassificera ert AI-system

Besvara tre frågor om ert AI-system och se vilken risknivå det hamnar på enligt EU AI Act.

Fråga 1 av 3

Vad används AI-systemet till?

Från AI-system till trygg användning

ISO 42001 kräver riskbaserat tänkande för AI. AmpliFlow gör det konkret.

Vad förändras i vardagen?

ISO 42001 handlar inte om att skriva dokument som ingen läser. Det handlar om konkreta förändringar i hur ni arbetar med AI:

Från "alla gör som de vill" till godkända verktyg

En tydlig lista över vilka AI-verktyg som får användas, med vilken data, och vem som ansvarar. Medarbetare vet vad som gäller utan att behöva fråga.

AI-utbildning från dag ett

Nya medarbetare får introduktion i organisationens AI-policy och verktyg. Inte en PowerPoint, utan en praktisk genomgång av vad som är tillåtet och varför.

AI-incidenter rapporteras och utreds

När något går fel med ett AI-system finns en process: rapportera, utreda, åtgärda, lära sig. Precis som för kvalitetsavvikelser, men anpassat för AI-specifika risker.

Regelbunden uppföljning

Kvartalsvis genomgång av AI-användning, incidenter och risker. Ledningen fattar beslut baserat på fakta, inte antaganden.

Från start till AI-styrning

En realistisk tidslinje för ISO 42001-implementering. Tiden varierar beroende på organisationens storlek och AI-mognad.

AI-inventering

1-2 vKartlägg alla AI-system och användningsområden i organisationen

Gap-analys

1-2 vJämför nuvarande styrning mot ISO 42001-kraven

Riskbedömning

2-3 vBedöma risker för varje AI-system enligt EU AI Acts risknivåer

Konsekvensbedömning

1-2 vBedöm hur era AI-system påverkar individer och samhället (6.1.4). Dokumentera enligt A.5.

Policy & processer

4-8 vUtveckla AI-policy, riktlinjer och styrdokument

Tillämplighetsförklaring (SoA)

1-2 vDokumentera vilka Annex A-kontroller ni tillämpar och motivera inkluderingar och undantag (6.1.3e)

Implementering

4-12 vInför kontroller, utbilda personal och börja tillämpa

Internrevision

1-2 vGranska AIMS-effektivitet och åtgärda brister

Varför ISO 42001?

För att AI redan är en del av verksamheten.

Slipp improviserad AI-styrning

Ni får ett tydligt sätt att styra verktyg, data, ansvar och uppföljning innan AI-användningen sprider sig vidare.

Svar som håller i kunddialoger och revisioner

När kunder eller revisorer frågar hur ni styr AI kan ni visa processen, inte bara prata om ambitioner.

Minskad risk

Strukturerad AI-styrning minskar risken för incidenter, dataläckor och felaktiga beslut utan att stoppa användbara verktyg.

En stark grund för framtida krav

ISO 42001 ger en praktisk struktur för EU AI Act-frågor, kundkrav och framtida certifiering om ni vill ta det steget senare.

Läs mer om ISO 42001

Vad är ISO/IEC 42001?

En genomgång av standarden för AI-ledningssystem: vad den kräver, hur den relaterar till andra standarder och varför den finns.

Läs artikeln →AmpliFlow i arbetsgruppen för ISO 42001

Hur AmpliFlow bidrar till utvecklingen av standarden och vad det betyder för våra kunder.

Läs artikeln →Ni behöver inte bygga egen AI för att behöva styrning

ISO 42001 blir relevant så fort AI påverkar hur ni arbetar, kommunicerar eller fattar beslut. För de flesta SMB-bolag börjar det med användning, inte utveckling.

Utvecklar ni egen AI? Då blir kraven ofta större. Men den vanligaste startpunkten är enklare: få kontroll på Copilot, ChatGPT och andra AI-funktioner som redan används i verksamheten.

Frågor om ISO 42001

Svar utan AI-jargong.

Vad är ett AI Management System (AIMS)?

AIMS är ett ledningssystem specifikt för AI-användning. Det definierar hur organisationen styr, övervakar och förbättrar sin AI-användning. Precis som ett ISMS för informationssäkerhet eller QMS för kvalitet.

Behöver vi ISO 42001 om vi inte utvecklar egen AI?

Ja, om ni använder AI-verktyg som ChatGPT, Copilot eller AI-baserade tjänster. ISO 42001 handlar om ansvarsfull användning av AI - inte bara utveckling. Alla organisationer där medarbetare använder AI-verktyg har nytta av standarden.

Hur hänger ISO 42001 ihop med EU AI Act?

EU AI Act är lagstiftning med krav och sanktioner. ISO 42001 är en frivillig standard som stödjer ert arbete med att möta lagkraven. Att implementera ISO 42001 underlättar EU AI Act-efterlevnad, men ISO 42001 är inte en harmoniserad standard och ger ingen automatisk presumtion om överensstämmelse.

Kan vi använda samma verktyg som för ISO 27001?

Ja. AmpliFlow har inbyggda kontroller för både ISO 27001 och ISO 42001 med AI-stöd, automatisk SoA och uppgiftshantering per kontroll. Utöver kontrollregistren delar standarderna samma verktyg: riskanalys, dokumentation via Pages, åtgärdshantering och checklistor.

Hur lång tid tar implementering?

Det beror på hur många AI-system ni har, hur mogen er nuvarande styrning är och om ni redan har andra ISO-certifieringar. Tiden handlar om att förankra nya arbetssätt, inte om att skriva dokument.

Måste vi certifiera oss?

Nej, certifiering är frivillig. Ni kan implementera ISO 42001 utan extern revision. Men certifiering ger trovärdig bevisning för kunder, partners och tillsynsmyndigheter.

Kan AI-modeller medvetet undvika kontroller?

Ja. Antropics forskning (december 2024) visade att AI-modeller kan uppvisa så kallad "alignment faking", att de beter sig annorlunda när de vet att de övervakas. I 12 procent av fallen agerade modellen mot sina instruktioner när den trodde sig vara oövervakad. Det är därför ISO 42001 kräver löpande övervakning, inte bara initial testning.

Vad är prompt injection och varför spelar det roll?

Prompt injection innebär att en angripare manipulerar AI-systemets instruktioner genom dold text i dokument eller webbsidor. Microsoft 365 Copilot-demonstrationen visade hur en angripare kunde extrahera känslig data genom att bädda in dolda instruktioner i ett delat dokument. ISO 42001 föreskriver inte specifika tekniska kontroller. Istället adresseras detta genom riskbedömning (6.1.2) som identifierar prompt injection som en risk, riskbehandling (6.1.3) som väljer lämpliga kontroller från Annex A, och krav på drift och övervakning (A.6.2.6) av AI-system.

Vad gör vi åt skugg-AI?

Skugg-AI (när medarbetare använder AI-verktyg utan organisationens vetskap) är en av de vanligaste riskerna. Steg ett: kartlägg faktisk AI-användning, inte bara godkänd användning. Steg två: skapa tydliga riktlinjer för vilka verktyg som får användas och med vilken data. Steg tre: gör det lättare att använda godkända verktyg än att gå runt systemet. ISO 42001 formaliserar detta genom krav på AI-policy och medvetandehöjning. Vi har skrivit mer om fenomenet i artikeln <a href='/artiklar/shadow-ai-anstallda-bygger-utan-it/'>Shadow AI: chefer bygger egna verktyg utan IT:s vetskap</a>.

Redo för ansvarsfull AI?

Boka en demo så visar vi hur AmpliFlow kan hjälpa er med AI-styrning.