Riktlinjer för generativ AI: vad DIGG och IMY vill att ni gör

Generativ AI är ett vardagsverktyg. Medarbetare använder ChatGPT, Copilot och liknande tjänster, ofta utan att organisationen har tagit ställning till hur. Det skapar risker: personuppgifter kan läcka, sekretessbelagd information kan hamna hos utomstående leverantörer, och ingen vet vem som ansvarar för det AI:n producerar.

DIGG (Myndigheten för digital förvaltning) och IMY (Integritetsskyddsmyndigheten) har tagit fram gemensamma riktlinjer för generativ AI. Riktlinjerna riktar sig till offentlig förvaltning, men råden är lika användbara för privata företag. De bygger på samma lagar: GDPR och EU:s AI-förordning.

Den här artikeln går igenom vad riktlinjerna betyder för privata företag och hur ni bygger in AI-styrning i ert befintliga ledningssystem.

Riktlinjer för generativ AI: börja med en policy

Det första steget enligt DIGG och IMY: ta fram en AI-policy. Inte för att det är ett krav i lag, utan för att medarbetare redan använder AI. Utan tydliga ramar bestämmer varje person själv vad som är okej.

En AI-policy bör ingå som styrdokument i ert ledningssystem. Den behöver inte heta “AI-policy”. Vilken intern struktur ni redan har för policyer och riktlinjer avgör var den passar bäst.

DIGG publicerar sin egen AI-policy öppet för alla att läsa och inspireras av. Den täcker konkreta frågor som organisationer brottas med:

- Vilka som omfattas: all personal, konsulter, praktikanter

- Vilka AI-verktyg som får användas (bara godkända, inga privata licenser)

- Förbud mot automatiserat beslutsfattande utan mänsklig kontroll

- Varning för AI-agenter som agerar självständigt och riskerar att tappa kontroll

- Krav på transparens: dokumentera när AI har använts

- Ekologisk hållbarhet: resurskrävande AI-användning (bild, video) bara när det är motiverat

- Öppenhet: AI-modeller och kod delas öppet som standard

DIGG betonar att ansvaret aldrig vilar på AI:n. Ni som medarbetare ansvarar för det AI genererar på samma sätt som för allt annat ni producerar i ert arbete.

GDPR gäller alltid, även utan personuppgifter i prompten

Det här är kanske den viktigaste punkten i riktlinjerna, och den som flest missar.

Många tänker: “Vi matar aldrig in personuppgifter i ChatGPT, alltså gäller inte GDPR.” Fel. Språkmodeller har tränats på data som innehåller personuppgifter. Redan det faktum att modellen kan generera information om individer kan utlösa GDPR-krav.

Tänk på det så här. En medarbetare klistrar in en kundlista i ChatGPT för att skriva ett mejl. Vem är personuppgiftsansvarig för den behandlingen? Vad säger ert personuppgiftsbiträdesavtal med OpenAI? Har ni ens ett sådant avtal? Det är de här frågorna som en GDPR-riskbedömning för AI faktiskt handlar om.

IMY:s vägledning om GDPR och AI fördjupar sig i frågan. De lyfter det de kallar “svarta lådan-problemet”: AI-modeller fungerar som slutna system där det kan vara svårt att förklara hur ett visst resultat uppstod. Det krockar med GDPR:s krav på transparens och individens rätt till information.

Frågor som varje organisation behöver besvara:

- Vilken rättslig grund har ni för behandlingen? Samtycke, berättigat intresse, avtal?

- Vem är personuppgiftsansvarig och vem är biträde? Relationen till AI-leverantören måste vara tydlig.

- Sker det överföring till tredje land? De flesta stora AI-modeller körs i USA.

- Behöver ni göra en konsekvensbedömning? DIGG rekommenderar att alltid göra det, även när det inte är ett formellt krav.

Det räcker inte att stoppa in en klausul i leverantörsavtalet. Ni behöver aktivt förstå vad som händer med data och kunna visa det.

EU:s AI-förordning: förbered er nu

EU:s AI-förordning (AI Act) klassificerar generativ AI som “AI för allmänna ändamål” (general purpose AI, GPAI). Reglerna för GPAI trädde i kraft 2 augusti 2025. De flesta övriga reglerna i AI-förordningen börjar gälla 2 augusti 2026.

DIGG pekar på att organisationer kan ha olika roller under förordningen: leverantör, operatör eller nedströms leverantör. Vilken roll ni har avgör vilka skyldigheter som gäller.

Även om ni bara använder AI, inte utvecklar den, kan ni vara operatör med skyldigheter. Exempelvis att informera användare om att de interagerar med AI och att ha rutiner för mänsklig övervakning.

Vänta inte. Börja med att kartlägga vilka AI-verktyg som används i organisationen, vilka roller ni har under förordningen, och vilka gap som finns.

Klassificera information innan den når ett AI-verktyg

Riktlinjerna är tydliga: klassificera information innan ni matar in den i ett AI-verktyg. Det gäller all information, inte bara den som är uppenbart hemlig.

DIGG:s egen riktlinje säger rakt ut: “Använd inte personuppgifter, sekretessbelagda uppgifter, säkerhetskänsliga uppgifter och sådana uppgifter som kan vara känsliga för myndigheten om de kommer ut.” Den regeln är lika vettig för privata företag. Byt ut “myndigheten” mot ert företagsnamn.

I offentlig sektor tillkommer att AI-genererat innehåll kan bli allmänna handlingar. Promptar och svar som sparas hos en myndighet omfattas troligen av offentlighetsprincipen, och vem som helst kan begära ut dem.

Men principen är densamma oavsett sektor: bedöm hur känslig informationen är innan ni skickar den till ett AI-verktyg.

Etik och hållbarhet som styrande principer

Riktlinjerna täcker mer än juridik. DIGG och IMY lyfter etiska principer som bör styra AI-användningen: transparens, ansvar, rättvisa och ekologisk hållbarhet.

Det sista är oväntat konkret. DIGG:s policy säger att medarbetare bara bör använda bildgenerering och videogenerering, som drar mycket beräkningskraft, “när det är motiverat”. Varje medarbetare förväntas vara medveten om AI:ns klimatpåverkan.

Transparens är en annan röd tråd. DIGG kräver att medarbetare anger när AI har använts som källa. När ni använder AI i tjänster riktade till allmänheten ska det framgå tydligt. Det handlar om förtroende: människor ska kunna veta om och hur AI har påverkat det de läser eller det beslut som rör dem.

Vad du bör göra: fyra steg

Baserat på DIGG och IMY:s riktlinjer finns det fyra saker som de flesta organisationer bör göra nu:

Skriv en AI-policy. Utgå från DIGG:s exempelpolicy. Den täcker vilka som omfattas (all personal, konsulter, praktikanter), vilka verktyg som är godkända, krav på transparens och hållbarhet. Anpassa den till er verksamhet, förankra den i ledningsgruppen och gör den till ett styrdokument i ert ledningssystem. Det behöver inte vara komplicerat. Ofta räcker fem till tio sidor.

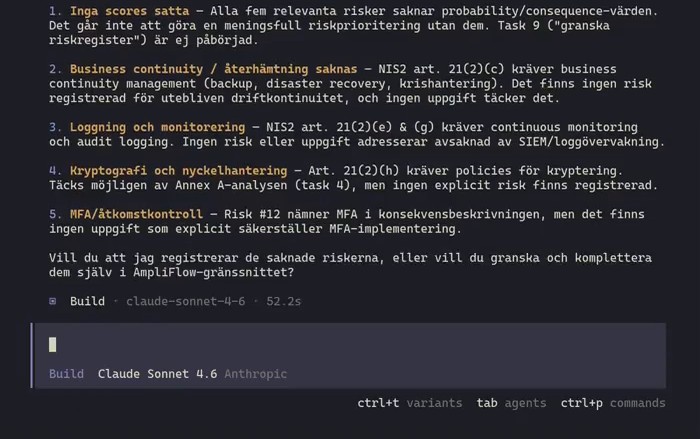

Bedöm GDPR-risker. Gå igenom vilka AI-verktyg medarbetare faktiskt använder, inte bara de ni har godkänt. Kartlägg var personuppgifter kan behandlas. Granska era biträdesavtal med AI-leverantörerna. Täcker de den behandling som faktiskt sker? Gör en konsekvensbedömning.

Kartlägg era roller under AI-förordningen. Är ni operatör, leverantör, eller bådadera? Vilka skyldigheter följer med varje roll? De flesta privata företag som använder ChatGPT eller Copilot är operatörer, och det innebär bland annat krav på information och mänsklig övervakning.

Inför informationsklassificering. Se till att medarbetare vet vilken typ av information som får och inte får matas in i AI-verktyg. Ge konkreta exempel: kunduppgifter, lönedata och affärshemligheter hör inte hemma i en extern chattjänst. Gör reglerna enkla att följa.

Inget av dessa steg kräver att ni slutar använda AI. Tvärtom. Poängen är att använda AI medvetet, med ramar som skyddar organisationen och de individer vars data berörs.

Bygg in det i ert ledningssystem

En AI-policy som ligger som en pdf på intranätet förändrar ingenting. Den behöver kopplas till processer som redan fungerar: riskbedömningar, dokumentstyrning, utbildning och uppföljning.

Företag som redan har ett ledningssystem för ISO 9001 eller ISO 27001 har ett försprång. AI-policyn behöver inte vara ett nytt dokument som svävar fritt. Den passar in i den dokumentstyrning, riskhantering och ledningens genomgång som ni redan har. Det vi ser är att organisationer som behandlar AI-styrning som ett separat projekt, vid sidan av sitt ledningssystem, aldrig riktigt får det att fastna.

Om ni vill koppla er AI-policy direkt till riskbedömningar och dokumentstyrning i ett system som redan hanterar er ISO-certifiering, boka en demo för att se hur det fungerar.