Ni har ett kvalitetssystem. Kanske ett miljöledningssystem. Ni vet vad det innebär att ha en policy, utse ansvariga och göra revisioner. ISO 42001 är samma sak, fast för AI-system.

Det är inte en teknisk standard. Den frågar inte hur era algoritmer fungerar. Den frågar vem som ansvarar när något går fel, om ni vet vilka AI-verktyg som används i verksamheten, och om ni har utvärderat era AI-leverantörer på samma sätt som era andra leverantörer.

Om ni redan hanterar ISO 9001 eller ISO 27001 är logiken bekant. Det som är nytt är vad “det” avser.

Vad ISO 42001 faktiskt är

ISO/IEC 42001:2023 är en internationell certifierbar standard för ledningssystem för artificiell intelligens. ISO publicerade den i december 2023. Den följer samma grundstruktur som ISO 9001 och ISO 27001, med klausulerna 4-10 för kontext, ledarskap, planering, support, drift, uppföljning och förbättring.

Det som gör standarden unik är tre AI-specifika krav: riskbedömning för AI-system (6.1.2), riskbehandling (6.1.3), och konsekvensbedömning (6.1.4). Det sista handlar om hur ett AI-system påverkar individer och samhället, inte bara organisationen.

Sedan finns Annex A med 38 kontroller fördelade på nio områden, från policy och datahantering till tredjepartsrelationer.

Varför nu?

Två saker händer parallellt.

Det första är EU AI Act. Förordningen gäller sedan februari 2025, och artikel 4 kräver att alla organisationer som använder AI-system ser till att berörd personal har tillräcklig AI-kompetens. Inte bara de som bygger AI. Alla som använder det i jobbet. Det gäller redan.

Den 2 augusti 2026 börjar resten av förordningen gälla: krav på riskhantering, dokumentation och mänsklig tillsyn för högrisk-system. Använder er verksamhet AI för att prioritera ärenden, analysera personaldata, betygsätta kunder eller fatta beslut som påverkar människor, kan det vara ett högrisk-system. Att ha ett organiserat sätt att hantera AI-frågor då är bättre än att börja bygga det när tillsynen knackar på.

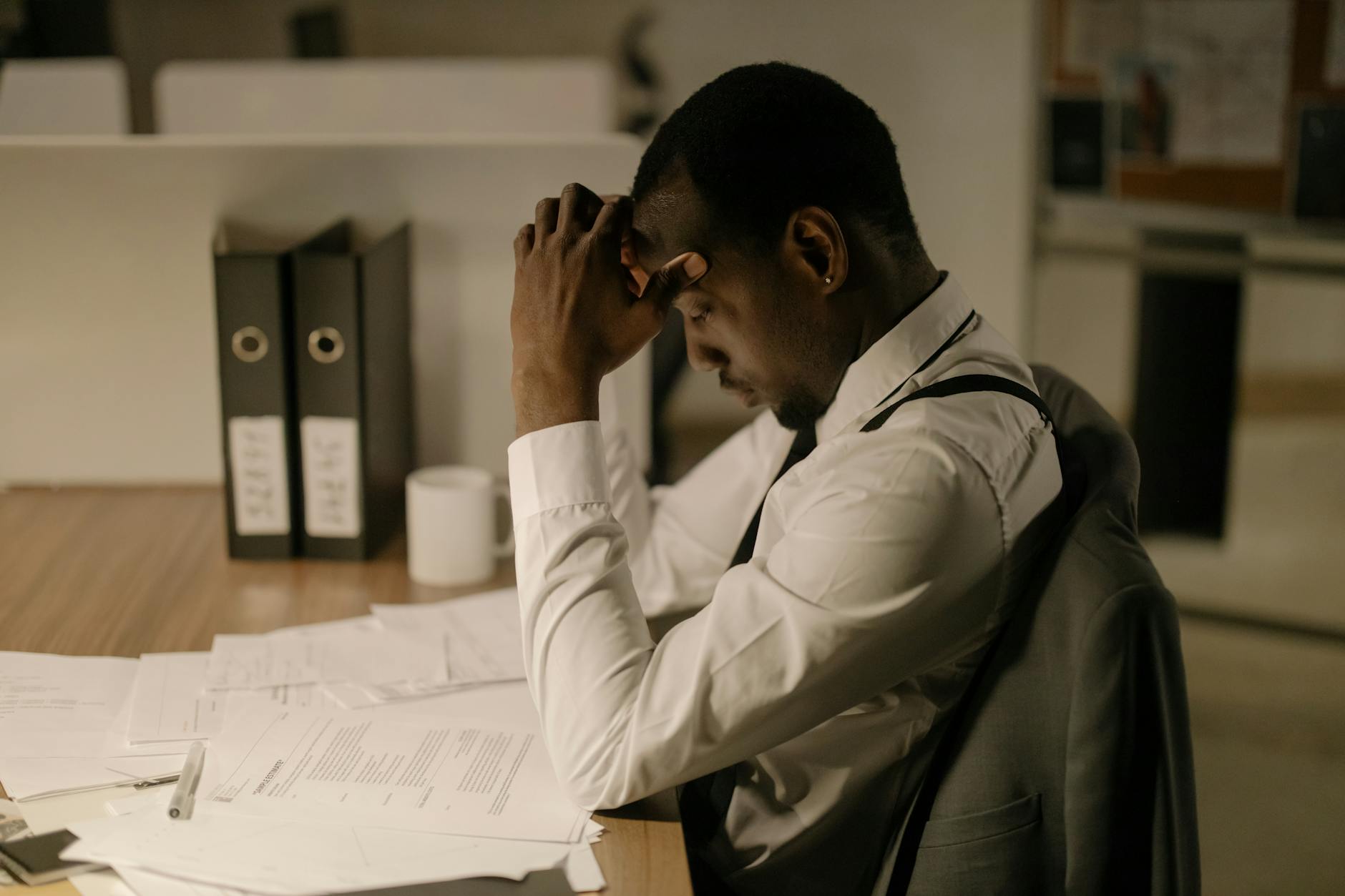

Det andra är Shadow AI. Undersökningar pekar på att 60 procent av de AI-verktyg som används i företag har byggts eller installerats utanför IT-avdelningens kontroll.1 Det är inte praktikanter som experimenterar. Det är chefer som hittade ett bra verktyg och började använda det. Resultatet: verksamhetsdata passerar system som ingen har utvärderat, med otydligt ansvar om något går fel.

Samsung har säkerhetsingenjörer som de flesta svenska SME-företag aldrig kommer anställa. I april 2023 klistrade några av dem in konfidentiell källkod i ChatGPT. Inga onda avsikter. De felsökte kod på det sätt verktyget är designat för. Data gick till OpenAIs servrar. Samsungs svar var inte bättre utbildning. Det var att stänga av AI-verktyg på alla företagsenheter.2

Kompetens skyddar inte. Governance gör det.

De fem kontrollerna: vad de faktiskt innebär

ISO 42001 är en frivillig standard, EU AI Act är bindande lag. De är inte samma sak. Men standarden ger er ett strukturerat sätt att möta de krav som lagen ställer, och ett dokumenterat svar på frågorna revisorer och kunder börjar ställa.

Annex A innehåller 38 kontroller. Fem av dem träffar direkt det som gör AI-styrning svårt i praktiken. Här är vad de faktiskt kräver, i standardens egna formuleringar.

A.2.2: AI-policy

Standardens text: “The organization shall document a policy for the development or use of AI systems.”

I praktiken: ni behöver en skriftlig policy som säger vilka AI-system ni godkänner för användning, under vilka villkor, och vad som krävs av de anställda som använder dem. Det är inte ett långt dokument. Det är ett klart ställningstagande. Typ: “Vi använder AI-assisterade verktyg för X och Y. Kunddata får inte matas in i konsumentversioner av externa AI-tjänster. Ansvarig: [namn].”

En policy handlar i första hand om klarhet, inte kontroll. Folk vill veta vad som gäller.

A.3.2: Roller och ansvar

Standardens text: “Roles and responsibilities for AI shall be defined and allocated according to the needs of the organization.”

Det här är inte ett IT-ansvar. Det är ett verksamhetsansvar. Någon på er organisation behöver äga frågan: “vi använder AI-system, och om något går fel är det den personens jobb att veta vad som hände.” Det behöver inte vara en ny tjänstetitel. Det kan vara kvalitetschefen. Det kan vara verksamhetschefen. Men det måste vara någon.

Skillnaden mot hur de flesta organisationer hanterar AI idag: idag äger ingen frågan.

A.5.2: Konsekvensbedömning

Standardens text: “The organization shall establish a process to assess the potential consequences for individuals and societies that can result from the AI system throughout its life cycle.”

När behöver ni göra en? När ett nytt AI-system tas i bruk, när ett befintligt system används på ett nytt sätt, eller när systemet påverkar beslut som direkt berör människor. Det krävs alltså inte för alla verktyg. Men för de system där AI-förslagets fel leder till att en anställd får fel lön, en kund nekas kredit, eller ett ärende prioriteras bort, behöver ni en dokumenterad process för att bedöma och hantera den risken.

Tänk på det som en riskbedömning, fast med ett bredare perspektiv än bara organisationens eget intresse.

A.9.2: Ansvarsfull användning

Standardens text: “The organization shall define and document the processes for the responsible use of AI systems.”

Vad innebär det? Ni behöver tydliga processer för vilka AI-system som är godkända för användning i verksamheten, vem som godkänner nya verktyg, och hur anställda rapporterar problem. Det är godkännandeprocesser, inte förbjudlistor. Målet är att göra det enkelt att använda AI på rätt sätt, inte svårt att använda AI alls.

Utan dokumenterade processer söker era anställda upp egna lösningar. Med tydliga processer har de en lista att utgå från.

A.10.3: Leverantörsbedömning

Standardens text: “The organization shall establish a process to ensure that its usage of services, products or materials provided by suppliers aligns with the organization’s approach to the responsible development and use of AI systems.”

OpenAI och Anthropic är era leverantörer när era anställda använder deras verktyg med er data. Det spelar ingen roll om det är via en företagslicens eller ett personligt konto. Ni behöver bedöma dem på samma sätt som ni bedömer andra kritiska leverantörer: vad händer med vår data, vilka certifieringar har de, vad gör de med informationen vi skickar?

Det är inte byråkrati. Det är leverantörshantering, precis som ni alltid gjort.

Förhållandet till ISO 27001

Om ni har ISO 27001 undrar ni kanske om ISO 42001 är dubbelarbete. Det är det inte.

ISO 27001 handlar om informationssäkerhet: hur skyddar ni er information från obehörig åtkomst, förlust och manipulation. ISO 42001 handlar om AI-styrning: hur kontrollerar ni hur AI-system används, vem som ansvarar, och vilken påverkan de har.

En organisation kan ha utmärkt informationssäkerhet och fortfarande sakna svar på frågan “vem godkänner nya AI-verktyg?” Det är olika problem.

I praktiken överlappar de på datahantering och leverantörsbedömning. Har ni redan ISO 27001-processer för leverantörsutvärdering, kan ni utöka dem att täcka AI-leverantörer. Har ni en informationsklassificering, använd den som grund för att bestämma vilken data som får matas in i externa AI-tjänster.

ISO 42001 följer samma High Level Structure som alla moderna ISO-standarder. Redan certifierade organisationer bygger ovanpå vad som finns.

Rimliga första steg

Tre saker ger er en solid grund utan att behöva bygga ett fullständigt ledningssystem från dag ett.

Inventera vilka AI-system ni faktiskt använder. Inte bara de IT-köpta och godkända. Be chefer och teamledare rapportera vilka verktyg de och deras team använder. Ni kommer hitta fler än ni tror. Resultatet är inte en lista att förbjuda, utan en lista att arbeta med.

Skriv en enkel AI-policy. En sida. Vad är tillåtet, vad kräver godkännande, vad är förbjudet. Kommunicera den. En policy som alla känner till är mer värd än ett detaljerat dokument som ingen har läst.

Utse en ansvarig person. Kvalitetschefen. Verksamhetschefen. Någonstans. Den personen behöver inte vara AI-expert. De behöver veta att de är kontaktpunkten när någon undrar vad som gäller, och att de håller listan över godkända verktyg uppdaterad.

De tre stegen adresserar direkt vad A.2.2, A.3.2 och A.9.2 kräver. De ger er också ett rimligt svar om artikel 4 i EU AI Act skulle prövas: ni kan visa att ni har tagit ett organiserat grepp om AI-användningen.

ISO 42001-certifiering är frivillig. EU AI Act är det inte. Men de två hänger ihop: standarden ger er ett sätt att visa att ni jobbar systematiskt med just de frågor lagen ställer krav på. Att ha svar på “vem ansvarar för AI-frågor i er organisation” och “vilka AI-system används med vilka data” kommer bli standard att kunna visa för kunder, partners och revisorer.

Mer om bakgrunden: i artikeln Varför betalar vi för mjukvara som AI kan bygga gratis? går vi igenom varför Shadow AI-frågan har blivit akut just nu, och hur ISO 42001:s kontroller adresserar det konkret. Vill ni se hur AmpliFlow stödjer ISO 42001-implementering: boka ett samtal.