En studie publicerad i Harvard Business Review i februari 2026 hittade något oväntat. Forskarna (Eatough, Ferrazzi, Smith, Waters) undersökte över 3 000 anställda i USA och Europa och mätte vad de kallar “AI angst”, oro kring vad AI betyder för ens jobb, värde och framtid.

Resultatet: de med högst oro använder AI mer än de med låg oro. 65% av jobbet AI-assisterat mot 42%. Men de har samtidigt dubbelt så hög motståndskänsla.

Forskarna beskriver beteendet som “performative rather than participatory”. Folk använder AI för att skydda sig, inte för att de tror på det.

88% av företag säger att de använder AI regelbundet. Åtta av tio anställda har stark oro kring minst en aspekt av vad AI betyder för dem. Siffrorna ser ut som framgång. Men under ytan pågår något annat.

Vad folk faktiskt oroar sig för

Det handlar inte om tekniken. Studien visar vad som driver oron:

- 65% oroar sig för att bli ersatta av någon som kan använda AI bättre

- 61% oroar sig för att kollegor inte ser deras unika värde längre

- 60% oroar sig för att AI-användning får andra att ifrågasätta deras kompetens

- 44% känner att AI gör dem dummare

Det är en identitetsfråga. Och den frågan driver beteendet mer än någon utbildning eller AI-strategi gör.

Mönstret känns igen. Det liknar hur organisationer hanterade kvalitetssystem för 20 år sedan: vi har en pärm, vi är certifierade, och ingen öppnar pärmen. Sammanfatta det här mejlet. Skriv om den här texten. En glorifierad stavningskontroll. Det räknas knappast som den strategiska fördel ledningsgruppen drömde om.

Mer utbildning löser det inte

Studien är tydlig med att de vanliga svaren inte fungerar. Mer utbildning och tydligare mandat. Forskarna skriver att ledare måste sluta behandla användning som bevis på engagemang.

Problemet är att folk använder AI och gör motstånd samtidigt. Det är inte att de vägrar. Det är att de gör precis tillräckligt för att inte sticka ut. Det ser ut som adoption i siffrorna. I verkligheten är det teater.

HBR-artikeln pekar på tre saker som behöver ändras. Förstå vilken typ av oro som dominerar i er bransch. Sluta mäta användning som om det vore samma sak som engagemang. Och skapa miljöer där det är tryggt att experimentera innan ni skalar.

Den sista punkten är intressant. Forskarna skriver om healthcare specifikt: “Without clear guardrails around safety, bias, accountability, and workflow integration, enthusiasm alone is not enough to sustain scalable, responsible adoption.” Styrning är inte en broms. Det är det som gör att folk vågar trycka på gasen.

Vad ISO 42001 faktiskt gör åt det

De flesta som hör “ISO-standard för AI” tänker teknik och compliance. Men ISO 42001 handlar (åtminstone i min läsning) förvånansvärt mycket om människor.

Standarden ber organisationer bedöma hur AI-system påverkar individers psykiska välbefinnande (B.5.2). Konsekvensbedömningen ska också dokumentera hur AI påverkar anställning och kompetensutveckling (B.5.3).

Frågan “vad händer med mitt jobb?” måste ställas formellt. Den kan inte stanna i fikarummet.

Standarden tvingar fram den konversation om AI och arbete som de flesta organisationer undviker.

Titta på vad den faktiskt kräver, mappat mot det forskarna hittade:

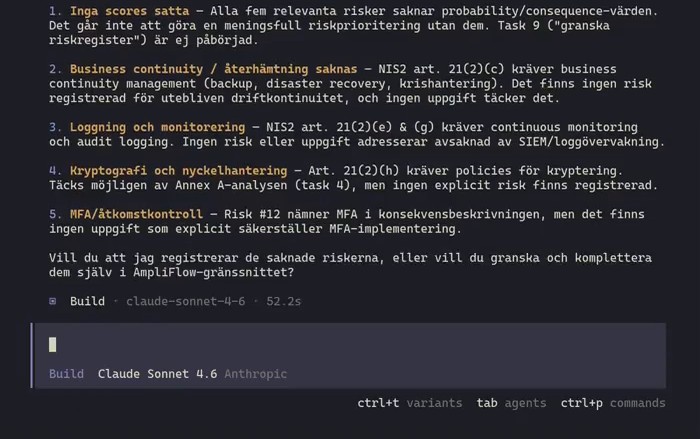

“Jag vet inte vad som är tillåtet” - Klausul 5.2 kräver en dokumenterad AI-policy som kommuniceras till alla i organisationen. Annex A.9.2 kräver dokumenterade processer för ansvarsfull AI-användning. Ingen ska behöva gissa.

“Vem ansvarar om det går fel?” - Klausul 5.3 kräver att roller och ansvar definieras och kommuniceras. A.3.2 konkretiserar det för AI-specifika roller. Annex C säger det rakt ut: “Where previously persons would be held accountable for their actions, their actions can now be supported by or based on the use of an AI system.” Ansvar när AI är inblandat är en ny typ av problem.

“Kommer AI att ersätta mig?” - Konsekvensbedömningen (6.1.4, A.5.4) kräver att ni bedömer påverkan på individer genom hela AI-systemets livscykel. B.5.3 kräver att ni dokumenterar hur AI påverkar anställning och kompetensutveckling. Och B.9.3 listar mänsklig överstyrning av AI-beslut som ett mål: “authority to override decisions made by the AI system.” Människan över maskinen, formellt.

“Vågar jag säga att något är fel?” - A.3.3 kräver en process där medarbetare kan rapportera oro kring AI-system. Implementeringsguiden (B.3.3) specificerar skydd mot repressalier och möjlighet till anonymitet. I princip en whistleblower-funktion för AI.

“Gör AI mig dummare?” - Klausul 7.2 kräver att ni identifierar vilken kompetens som behövs och ser till att folk faktiskt har den. Annex C talar om behovet av “dedicated specialists with interdisciplinary skill sets.” Standarden säger alltså att AI kräver mer kompetens, inte mindre.

Det som gör skillnad

Ledningen måste leva kulturen, inte delegera den med ett policydokument. Klausul 5.1 noterar att toppledningen bör arbeta med att “establishing, encouraging and modelling a culture within the organization, to take a responsible approach to using, development and governing AI systems.” Att skicka ut en policy och hoppas på det bästa räcker inte.

Har ni redan ett ledningssystem för ISO 9001 eller 27001? ISO 42001 följer samma Annex SL-ramverk, så ni bygger AI-styrningen ovanpå det ni redan har.

Patrik Björklund och Joakim Stenström på AmpliFlow var med i arbetsgruppen som tog fram ISO 42001. Vi bygger stöd för AI-styrning i samma system där ni hanterar era befintliga ISO-certifieringar. Vill ni se hur det kopplar ihop, boka ett samtal.

Mer om standarden: introduktion till ISO 42001 och kopplingen till EU:s AI-förordning.